Das ist es:

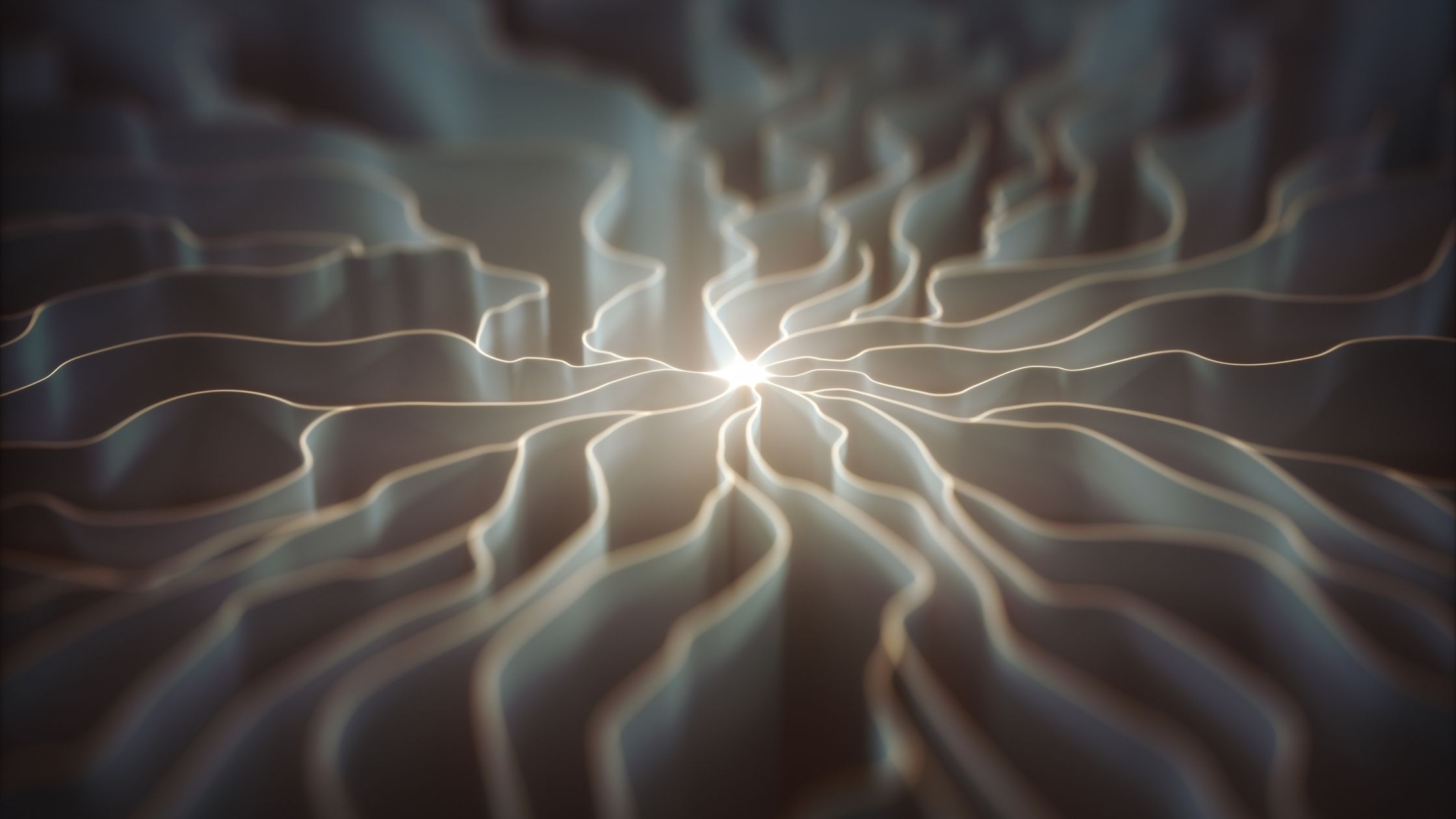

Künstliche Neuronale Netze (KNN) versuchen, ähnlich wie das menschlich Gehirn, Informationen zu verarbeiten, indem Informationsverarbeitungseinheiten (Neuronen) miteinander vernetzt werden: Die Neuronen (auch Knotenpunkte) eines künstlichen neuronalen Netzes sind schichtweise in sogenannten Layern angeordnet und in der Regel in einer festen Hierarchie miteinander verbunden. Die Neuronen sind dabei zumeist zwischen zwei Layern verbunden (Inter-Neuronlayer-Connection). Durch diese Vernetzungen können viele Informationen gleichzeitig analysiert werden.

So funktioniert es:

Ein Neuronales Netz besteht im Allgemeinen aus einer Sammlung von verbundenen Knoten, Neuronen genannt. Diese künstlichen Neuronen sind den biologischen Neuronen nachempfunden.

Die typische Architektur eines Neuronalen Netzes besteht aus mehreren Schichten.

Die erste Schicht bezeichnet man als Input Layer (Eingabeschicht). Die Input Layer erhält Daten, aus denen das neuronale Netz lernen soll. Die Eingabeschicht hat so viele Neuronen, wie es für die Aufgabe zu erfassende Daten gibt. Die zweite Schicht, ist die sogenannte Zwischenschicht, auch Aktivitätsschicht oder verborgene Schicht von engl.: hidden layer. Je mehr Zwischenschichten es gibt, desto tiefer ist das neuronale Netz, im englischen spricht man daher auch von „Deep Learning“. Diese Zwischenschicht ist verborgen, man „sieht“ nicht, welche Analysen hier stattfinden. Theoretisch ist die Anzahl der möglichen verborgenen Schichten in einem künstlichen neuronalen Netzwerk unbegrenzt. In der Praxis bewirkt jede hinzukommende verborgene Schicht jedoch auch einen Anstieg der benötigten Rechenleistung, die für den Betrieb des Netzes notwendig ist. Es gibt also eine Computerkapazitätsgrenze, keine Schichtengrenze bei NN.

Die dritte und letzte Schicht wird als Output Layer (Ausgabeschicht) bezeichnet; hier werden die Ergebnisse darstellt, die das neuronale Netz ermittelt hat. Das können z.B. Klassifizierungen der Daten des Input Layer sein. Um diese Klassifizierung vorzunehmen, muss das Netzwerk über Algorithmen mathematische Operationen durchführen. Diese Operationen werden in den Hidden Layers (versteckten Schichten) zwischen der Input und Output Layer ausgeführt. Eine Klassifizierung könnte z.B. die Definition der Rasse eines bestimmten Hundes anhand von Bildern sein. Hierfür werden die Bilder in die Input Layer eingegeben. Das Bild wird, um ihnen ein Zahlenwert zuzuteilen, in seine Pixel aufgebrochen. In den Hidden Layers wird nun mit diesen Werten gerechnet. Im Beispiel zeigt das Output Layer z.B. anschließend an, dass es sich bei diesem Bild zu 2 % um einen Pudel, 95 % um einen Terrier und 3 % um einen Schäferhund handelt. Je mehr Daten eingegeben werden, umso genauer wird die Zuordnung.

Beispiele für Neuronale Netze:

Durch die Fähigkeit, Muster aus unstrukturierten Datenmengen zu erkennen, werden Neuronale Netze im Deep Learning immer bedeutsamer. Sie werden z.B. in der Spracherkennung, Schrifterkennung und Bilderkennung genutzt, halten aber auch in Frühwarnsystemen oder bei Übersetzungssoftware Einzug. Mit Neuronalen Netzen können Klassifikationen und Regressionen durchgeführt werden, sie eignen auch für Clustering oder der Verringerung von Datendimensionen.

Neuronale Netze in der Zukunft:

Neuronale Netze werden die Verbreitung von Deep Learning weiter vorantreiben, da ihre Anwendung sehr vielfältig ist. Genau wie andere Arten von KI benötigen NN Daten, um zu lernen: Je mehr Daten, umso besser und schneller lernt eine KI mittels NN. Die Kraft von einem Neuronale Netze ist durch die Leistung des Computers begrenzt. Je komplexer die Aufgaben ist, desto mehr Rechenleistung wird für die steigende Anzahl an Hidden Layers benötigt. Und: Ein großer Teil der Lernleistung findet „hidden“, also verborgen statt. Zu schnell und zu komplex für Menschen. Dadurch steigt auch das Unbehagen vieler Menschen, mit den Ergebnissen zu arbeiten, die im Verborgenen entstehen.